App installieren

So wird die App in iOS installiert

Folge dem Video um zu sehen, wie unsere Website als Web-App auf dem Startbildschirm installiert werden kann.

Anmerkung: This feature may not be available in some browsers.

Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

Neueste KI zur Bilderzeugung

- Ersteller Lois

- Erstellt am

einseinsnull

[nur noch PN]

die server werden immer schneller, das generieren dauert inzwischen zu manchen tageszeiten weniger als 10 sekunden.

die version 3.1 bringt sehr gute ergebnisse hervor und gibt dir jetzt dateinamen vor, die aus der prompt bestehen.

das mag man praktisch finden, aber es bringt auch ein neues problem mit, nämlich dass gleiche prompts dann zu gleichen namen führen und man via browser save dialog das ziel umbenennen müsste um es überhaupt abspechern zu können.

denn ich arbeite mit 10 tabs und automatisiere das alles mit mouserecordern und brauche teilweise 100 bilder, die alle auf dem gleichen prompt basieren.

jemand eine idee wie da jetzt das abspeichern organisieren kann?

meine eigenen audio- und bildbearbeitungsprgoramme haben das eingebaut wenn man´s braucht: man drückt erneut return, und die output datei wird gleichername002.bin genannt. firefox kann das logischerweise nicht...

die version 3.1 bringt sehr gute ergebnisse hervor und gibt dir jetzt dateinamen vor, die aus der prompt bestehen.

das mag man praktisch finden, aber es bringt auch ein neues problem mit, nämlich dass gleiche prompts dann zu gleichen namen führen und man via browser save dialog das ziel umbenennen müsste um es überhaupt abspechern zu können.

denn ich arbeite mit 10 tabs und automatisiere das alles mit mouserecordern und brauche teilweise 100 bilder, die alle auf dem gleichen prompt basieren.

jemand eine idee wie da jetzt das abspeichern organisieren kann?

meine eigenen audio- und bildbearbeitungsprgoramme haben das eingebaut wenn man´s braucht: man drückt erneut return, und die output datei wird gleichername002.bin genannt. firefox kann das logischerweise nicht...

NickLimegrove

Flexiganer

NickLimegrove

Flexiganer

NickLimegrove

Flexiganer

NickLimegrove

Flexiganer

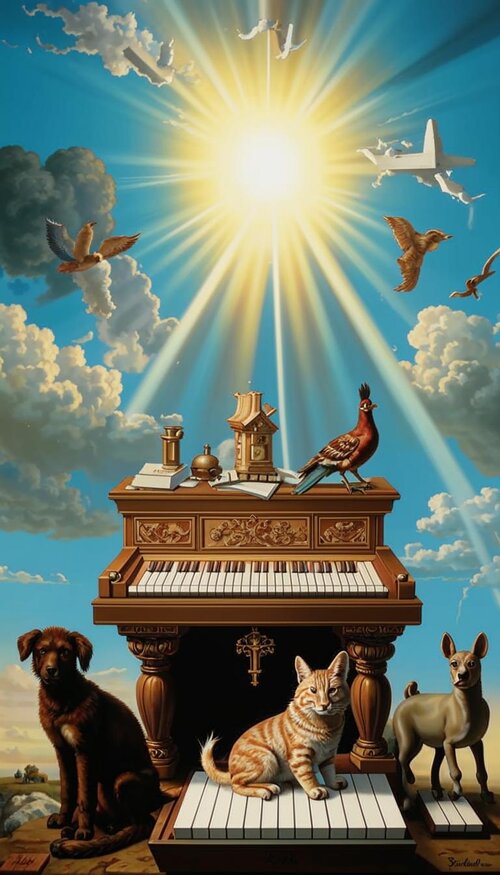

4x Kandinsky 3.1

A harpsichord with a donkey, [!] a dog, a cat, and a cockerel underneath it, in the background there is blue sky with only one cloud and the sun shining behind it, emitting a wide ray of light shining onto the piano. There is also an angel [hä?] sitting on the cloud.

A car mechanic lying on the floor underneath a grand piano, which standing on a lifting ramp in order to be repaired.

A grand piano on a lifting platform in a car workshop, with a mechanic trying to repair it from underneath.

A car mechanic with his tools, lying underneath a grand piano, trying to repair it from below.

A harpsichord with a donkey, [!] a dog, a cat, and a cockerel underneath it, in the background there is blue sky with only one cloud and the sun shining behind it, emitting a wide ray of light shining onto the piano. There is also an angel [hä?] sitting on the cloud.

A car mechanic lying on the floor underneath a grand piano, which standing on a lifting ramp in order to be repaired.

A grand piano on a lifting platform in a car workshop, with a mechanic trying to repair it from underneath.

A car mechanic with his tools, lying underneath a grand piano, trying to repair it from below.

Zuletzt bearbeitet:

Martin Kraken

Anfänger

Wie genial die KI ist. Nen Mensch passt halt nicht sitzend unter einen Flügel.

Summa

hate is always foolish…and love, is always wise...

NicGrey

[¥]

… nach dem Anblick diese Bildes geht für mich HR Giger's Biomechanics schon fast als Jugendbuch durch.

Summa

hate is always foolish…and love, is always wise...

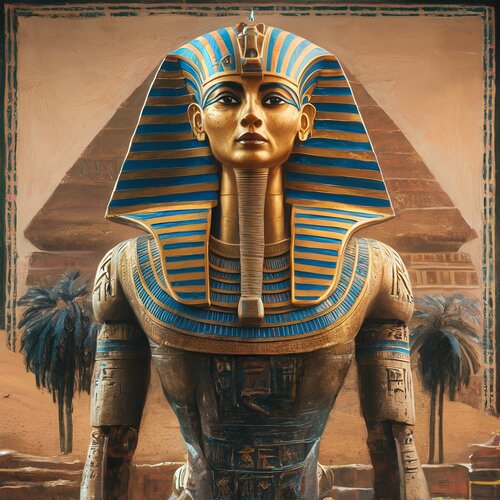

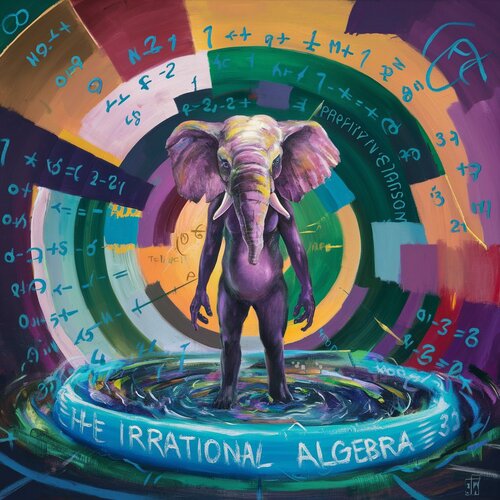

Das hat die K.I. bei "Amon Tobin - 4 Ton Mantis" ausgespuckt

ollo

||||||||||||

Passt nicht:

Anhang anzeigen 217997

Auch hier etwas eng:

Anhang anzeigen 217996

Jetzt passt es:

Anhang anzeigen 217998

Am 12ten ist Releasetermin für einen Teil von Stable Diffusion 3, bin mal gespannt. Das oben ist SD XL.

Wie genial die KI ist. Nen Mensch passt halt nicht sitzend unter einen Flügel.

Mit einem Trick geht es dann doch. Einfach erst ein Foto von einem Piano generieren und dann den Bereich darunter markieren und Stable Diffusion per Inpainting noch eine Frau unter das Piano setzen lassen. Sieht sogar ziemlich gut aus das Ergebniss.

Oder man macht eine total einfache Strichzeichnung von einer Frau unter einem Piano und gibt das der KI als Vorlage. Oft genügen einfachste Zeichnungen und man gibt der KI ziemlich viel Freiraum. Wenn dann ein Bild schonmal besser ist als die Zeichnung nimmt man das als Grundlage und hangelt sich weiter.

Golden-Moon

Ambient...to the sky and back

Golden-Moon

Ambient...to the sky and back

S

SOUNDDIGGER

|

ich finde es aber klasse, dass es manche bots es heute schon schaffen 500 posts in ein forum zu schreiben, ohne dass jemand etwas merkt.

Und aktuell gehe sehr gern auf russische Webseiten….

Golden-Moon

Ambient...to the sky and back

Golden-Moon

Ambient...to the sky and back

Similar threads

- Antworten

- 1K

- Aufrufe

- 169K

- Frage

- Antworten

- 218

- Aufrufe

- 12K

- Antworten

- 7

- Aufrufe

- 1K

- Antworten

- 90

- Aufrufe

- 8K

T

- Antworten

- 97

- Aufrufe

- 7K

T

News

-

-

Tubbutec Programmer für Synthesizer Zusatzfunktionen - MonoPoly, MC202, Juno 60 etc

- Gestartet von Moogulator

- Antworten: 6

-

News SequencerTalk 237 - Drei-Vier-Synclavier - Rückkehr mit anderem Preis, Granular Module und Radio - live 20:30

- Gestartet von Moogulator

- Antworten: 1

-

News Synclavier Keyboard kommt zurück als Ork II (mit Regen als Basis)

- Gestartet von Moogulator

- Antworten: 0

-

Frequency Central Florian - die Synth Stimme Roland-Style

- Gestartet von Moogulator

- Antworten: 2

-

News SequencerTalk 236 - Synthesizer Entwicklung durch "Hypes" und X-fer Serum 2 - ein mächtiger Synth

- Gestartet von Moogulator

- Antworten: 1

-

News Nerdlich der Mitte - Eindrücke, Bilder, Videos 2025

- Gestartet von Moogulator

- Antworten: 24