_thomas_

c[•∠•]ɔ

Durch eine kleine Diskussion im Pure-Data-Faden sind bei mir nun ein paar Fragen entstenden die eher musiktheoretischer Natur sind.

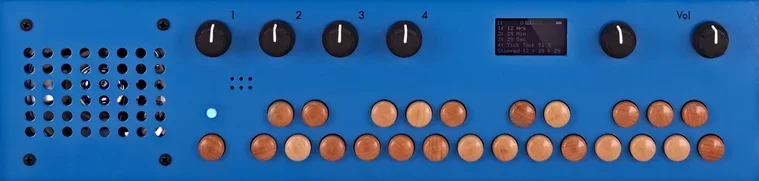

Ich bastel mir gearde einen Sequencer für den Organelle und will das Thema für mich mal beerdigen. Bedeutet, ich würde es gern korrekt und nachhaltig lösen. Aber es muss natürlich auch praktikabel bleiben. Die Plattform hat so ihre Möglichkeiten die mir zur Verfügung stehen und die ich einsetzen kann um mein Ziel zu erreichen. Ziemlich eingeschränkte Möglichkeiten. Das Display ist grundsätzlich auch Grafikfähig, allerdings ist z.B. so etwas wie eine Pianorolle o. ä. nur schwierig umzusetzen. Also werde ich mich auf eine textuelle Darstellung einschränken. Und diese ist auch üblich auf dem Gerät.

Von Sequencern habe ich keine große Ahnung. Letztendlich geht es ja nur darum, zu einem definierten Zeitpunkt ein Ereignis auszulösen. Z. B. eine Note zu spielen. Ich habe mal etwas mit den Elektrons experimentiert. Da gibt es zwar die Einteilung in 4er Gruppen. Prinzipell aber wird bei einem Puls einfach das für den im Ablauf konfigurierte Ereignis ausgelöst/Aktionen durchgeführt. Zusätzlich kann ich ein Micro-Timing auf einem Ereignis konfigurieren. Das sorgt dafür, dass das Ereignis eben nicht exakt auf dem Puls, sondern vorher oder hinterher ausgelöst wird. Es bleibt aber bei 4 Ereignissen pro Abschnitt (ich nenne solch einen Abschnitt jetzt mal Takt). Okay, es gibt bei den Elektrons auch noch das Ratcheting. Vergessen wir das mal.

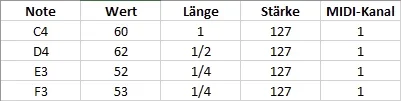

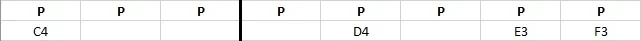

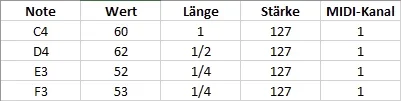

Hinauslaufen wird es wohl auf so etwas wie einen MIDI Tracker, der eben die Note und ein paar weitere Daten erfassen und in dieser Form darstellen kann:

etc...

Für den Organelle eine gute Darstellungsform.

Kommen wir jetzt zu meinem intellektuellen Problem. Das eigentlich Problem ist, dass ich in der Musiktheorie eher am Anfang stehe. Wobei ja Vieles da auch einfach logisch (weil Mathe) ist. Gepaart mti meinen nur rudimentären Kenntnissen bezüglich Sequencing ergeben sich ein paar Fragen für mich.

Notenlängen, Pausen:

Ganze Note, halbe Note, viertel Note,...,sechzehntel Note. Oder zwounddreißigstel Note. Die Notenlänge beschreibt im Grunde, wie lange diese Note gehalten werden muss. Oder auch (viel wichtiger wahrscheinlich für einen Sequencer), wann die nächste Note gespielt muss, oder wann das nächste Ereignis ausgelöst werden soll. Die ganze Note muss also einen ganzen Takt gehalten werden. Von der viertel Note müssen innerhab eines Taktes vier gespielt werden. Usw... Eine Information einer Pause ist für einen Sequencer wahrscheinlich eher unwichtig. Oder auch nicht, wenn es um das Microtiming geht. Beispiel: Ich möchte, dass eine Note für einen Takt gehalten werden soll. Dann soll aber ein viertel Takt Pause sein, dann eine halbe Note gespielt werden und dann wieder eine viertel Note Pause sein.

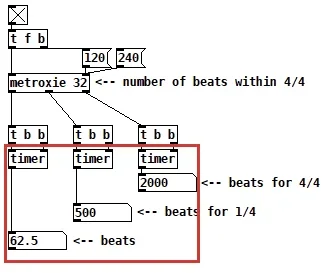

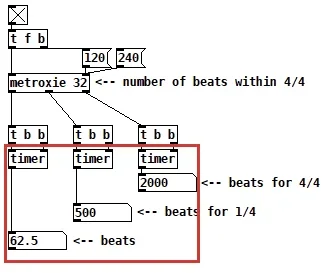

Noch komplizierter wird es ja, wenn ich eine Note nicht mit dem Puls, sondern irgendwo zwischen zwei Pulsen spielen möchte. Wobei das ja eher eine Frage der Auflösung ist. In der Praxis: Bei 120 BPM habe ich 120 Pulse die Minute. Ein Puls wird klassischerweise als viertel Note angesehen. Wie löse ich Ereignisse zwischen zwei Pulsen aus wenn ich sage, ich möchte z.B. 16tel Noten spielen können? Oder exakt zwischen zwei Pulsen? Intern arbeite ich dann halt nicht mit 120 sondern mit 480 Pulsen pro Minute. Vielleicht ist eine Auflösung von 32 in einem Takt aber notwendig? Dann bin ich bei 960 Pulsen pro Minute mit einer Pulsdauer von ca. 62,5 ms.

Was ist nun die Frage? Ich habe sie mir schon selbst beantwortet. Ich möchte dem Nuzter natürlich die Rechnerei ersparen. Aber trotzdem die Möglichkeiten bieten auch mal anders als mit 1/4 im 4/4 Takt zu operieren. Ich werde einfach 1/4 und 4/4er Takt vorgeben. Das sind die meisten gewohnt und da muss man nicht großartig nachdenken. Wer will, kann dann auch bis 1/32 runter und auch Pausen definieren. Für die Freunde der Synkope. Aber dann muss man rechnen.

Ein wenig Sorge hat mir das Metronom auf dem Organelle hinsichtlich seinr Genauigkeit gemacht. Aber nach einer Messung scheinen die Abweichungen in einem wirklich winzigen Bereich zu sein. Die Zeitmessungen sind absolut stabil und zucken nicht mal.

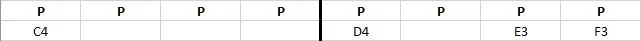

Das bringt mich direkt zu einem weiteren Thema: der Takt. 4/4 ist ja recht simpel (obige Noten):

3/4:

Aber es gibt ja auch sowas wie 6/8 und weiß der Geier was noch. Eigentlich ist das ja nur eine Aussage darüber, wie viele Noten einer bestimmten (halbe, virtel, achtel, etc.) einen Takt ausmachen. Das ist wohl eher ein Thema mit der Betonung nehme ich an.

Für einen Sequencer ist das wahrscheinlich unerheblich. Oder ist das falsch? Muss ich da etwas berücksichtigen?

Ich bastel mir gearde einen Sequencer für den Organelle und will das Thema für mich mal beerdigen. Bedeutet, ich würde es gern korrekt und nachhaltig lösen. Aber es muss natürlich auch praktikabel bleiben. Die Plattform hat so ihre Möglichkeiten die mir zur Verfügung stehen und die ich einsetzen kann um mein Ziel zu erreichen. Ziemlich eingeschränkte Möglichkeiten. Das Display ist grundsätzlich auch Grafikfähig, allerdings ist z.B. so etwas wie eine Pianorolle o. ä. nur schwierig umzusetzen. Also werde ich mich auf eine textuelle Darstellung einschränken. Und diese ist auch üblich auf dem Gerät.

Von Sequencern habe ich keine große Ahnung. Letztendlich geht es ja nur darum, zu einem definierten Zeitpunkt ein Ereignis auszulösen. Z. B. eine Note zu spielen. Ich habe mal etwas mit den Elektrons experimentiert. Da gibt es zwar die Einteilung in 4er Gruppen. Prinzipell aber wird bei einem Puls einfach das für den im Ablauf konfigurierte Ereignis ausgelöst/Aktionen durchgeführt. Zusätzlich kann ich ein Micro-Timing auf einem Ereignis konfigurieren. Das sorgt dafür, dass das Ereignis eben nicht exakt auf dem Puls, sondern vorher oder hinterher ausgelöst wird. Es bleibt aber bei 4 Ereignissen pro Abschnitt (ich nenne solch einen Abschnitt jetzt mal Takt). Okay, es gibt bei den Elektrons auch noch das Ratcheting. Vergessen wir das mal.

Hinauslaufen wird es wohl auf so etwas wie einen MIDI Tracker, der eben die Note und ein paar weitere Daten erfassen und in dieser Form darstellen kann:

etc...

Für den Organelle eine gute Darstellungsform.

Kommen wir jetzt zu meinem intellektuellen Problem. Das eigentlich Problem ist, dass ich in der Musiktheorie eher am Anfang stehe. Wobei ja Vieles da auch einfach logisch (weil Mathe) ist. Gepaart mti meinen nur rudimentären Kenntnissen bezüglich Sequencing ergeben sich ein paar Fragen für mich.

Notenlängen, Pausen:

Ganze Note, halbe Note, viertel Note,...,sechzehntel Note. Oder zwounddreißigstel Note. Die Notenlänge beschreibt im Grunde, wie lange diese Note gehalten werden muss. Oder auch (viel wichtiger wahrscheinlich für einen Sequencer), wann die nächste Note gespielt muss, oder wann das nächste Ereignis ausgelöst werden soll. Die ganze Note muss also einen ganzen Takt gehalten werden. Von der viertel Note müssen innerhab eines Taktes vier gespielt werden. Usw... Eine Information einer Pause ist für einen Sequencer wahrscheinlich eher unwichtig. Oder auch nicht, wenn es um das Microtiming geht. Beispiel: Ich möchte, dass eine Note für einen Takt gehalten werden soll. Dann soll aber ein viertel Takt Pause sein, dann eine halbe Note gespielt werden und dann wieder eine viertel Note Pause sein.

Noch komplizierter wird es ja, wenn ich eine Note nicht mit dem Puls, sondern irgendwo zwischen zwei Pulsen spielen möchte. Wobei das ja eher eine Frage der Auflösung ist. In der Praxis: Bei 120 BPM habe ich 120 Pulse die Minute. Ein Puls wird klassischerweise als viertel Note angesehen. Wie löse ich Ereignisse zwischen zwei Pulsen aus wenn ich sage, ich möchte z.B. 16tel Noten spielen können? Oder exakt zwischen zwei Pulsen? Intern arbeite ich dann halt nicht mit 120 sondern mit 480 Pulsen pro Minute. Vielleicht ist eine Auflösung von 32 in einem Takt aber notwendig? Dann bin ich bei 960 Pulsen pro Minute mit einer Pulsdauer von ca. 62,5 ms.

Was ist nun die Frage? Ich habe sie mir schon selbst beantwortet. Ich möchte dem Nuzter natürlich die Rechnerei ersparen. Aber trotzdem die Möglichkeiten bieten auch mal anders als mit 1/4 im 4/4 Takt zu operieren. Ich werde einfach 1/4 und 4/4er Takt vorgeben. Das sind die meisten gewohnt und da muss man nicht großartig nachdenken. Wer will, kann dann auch bis 1/32 runter und auch Pausen definieren. Für die Freunde der Synkope. Aber dann muss man rechnen.

Ein wenig Sorge hat mir das Metronom auf dem Organelle hinsichtlich seinr Genauigkeit gemacht. Aber nach einer Messung scheinen die Abweichungen in einem wirklich winzigen Bereich zu sein. Die Zeitmessungen sind absolut stabil und zucken nicht mal.

Das bringt mich direkt zu einem weiteren Thema: der Takt. 4/4 ist ja recht simpel (obige Noten):

3/4:

Aber es gibt ja auch sowas wie 6/8 und weiß der Geier was noch. Eigentlich ist das ja nur eine Aussage darüber, wie viele Noten einer bestimmten (halbe, virtel, achtel, etc.) einen Takt ausmachen. Das ist wohl eher ein Thema mit der Betonung nehme ich an.

Für einen Sequencer ist das wahrscheinlich unerheblich. Oder ist das falsch? Muss ich da etwas berücksichtigen?